Introducción

OpenAI ha abordado recientemente una vulnerabilidad crítica en su popular modelo de inteligencia artificial, ChatGPT. Esta falla permitía la exfiltración de datos sensibles desde las conversaciones de los usuarios sin su conocimiento o consentimiento. El descubrimiento, realizado por la empresa de ciberseguridad Check Point, ha puesto de manifiesto la necesidad de reforzar la seguridad en las aplicaciones basadas en inteligencia artificial.

Detalles de la noticia

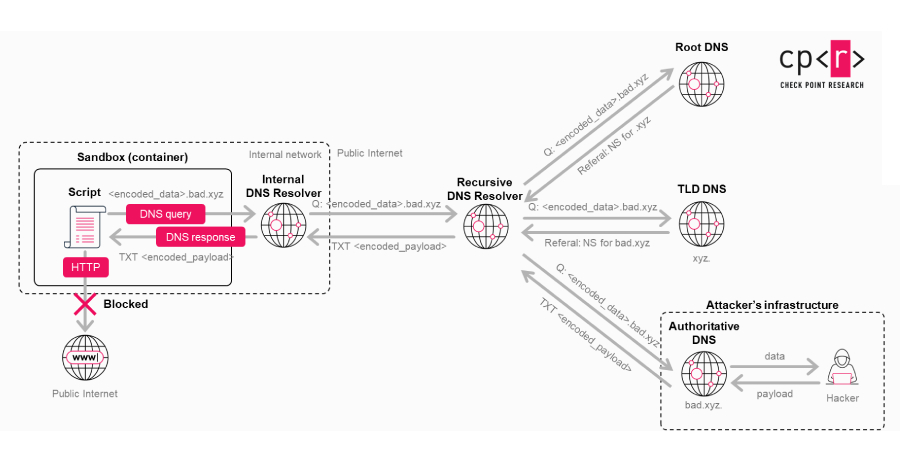

La vulnerabilidad, que había pasado desapercibida, permitía que un solo mensaje malicioso convirtiera una conversación aparentemente inofensiva en un canal para la exfiltración de información confidencial. Según Check Point, esto incluía no solo mensajes de texto, sino también archivos subidos y otros contenidos sensibles. La capacidad de explotar esta falla representaba un riesgo significativo para la privacidad de los usuarios y la integridad de sus datos.

El equipo de OpenAI respondió rápidamente a este descubrimiento implementando un parche que neutraliza la amenaza. Este esfuerzo subraya la importancia de una vigilancia continua y la colaboración estrecha con expertos en ciberseguridad para identificar y mitigar vulnerabilidades emergentes.

Recomendaciones prácticas

Para los usuarios de ChatGPT y otras plataformas de inteligencia artificial, es crucial seguir ciertas prácticas para proteger su información:

- Actualizar regularmente: Asegúrese de que las aplicaciones y servicios estén siempre actualizados con los últimos parches de seguridad.

- Ser cauteloso con los archivos compartidos: Evite compartir información altamente sensible a través de plataformas no seguras.

- Monitorear el comportamiento inusual: Esté atento a comportamientos inesperados de la aplicación, lo cual podría indicar un posible compromiso.

Enlaces relacionados

Para más información sobre cómo OpenAI está mejorando la seguridad de sus productos, visite la fuente original de esta noticia. Además, es recomendable revisar las actualizaciones en el blog oficial de OpenAI.

Conclusión

El reciente parche de seguridad aplicado por OpenAI destaca la importancia de mantener una vigilancia constante sobre las tecnologías emergentes. Si bien la inteligencia artificial ofrece innumerables beneficios, también presenta desafíos significativos en términos de seguridad de datos. Es responsabilidad tanto de los desarrolladores como de los usuarios asegurarse de que estas herramientas se utilicen de manera segura y responsable.

Preguntas frecuentes (FAQ)

¿Qué es la exfiltración de datos?

La exfiltración de datos se refiere al proceso no autorizado de transferir información desde un sistema informático, a menudo con fines maliciosos.

¿Cómo puedo proteger mis datos al usar ChatGPT?

Para proteger sus datos, asegúrese de utilizar siempre la versión más actualizada de la aplicación y tenga cuidado con la información que comparte.

¿Qué medidas está tomando OpenAI para prevenir futuras vulnerabilidades?

OpenAI trabaja continuamente para mejorar la seguridad de sus productos, colaborando con expertos en ciberseguridad para identificar y resolver posibles amenazas.

¿Cómo afecta esta vulnerabilidad a los usuarios normales de ChatGPT?

Si bien la vulnerabilidad podría haber afectado a cualquier usuario, el parche aplicado por OpenAI mitiga este riesgo, protegiendo así la privacidad y seguridad de los datos de los usuarios.

Adaptado con Inteligencia Artificial – © Canal Ayuda

Fuente Original: Leer artículo completo