Introducción al Agente de Inteligencia Artificial

Los agentes de inteligencia artificial (IA) han evolucionado rápidamente, pasando de ser una herramienta para generar código a una que puede ejecutar tareas completas de desarrollo de software. Herramientas como Copilot, Claude Code y Codex no solo escriben código, sino que también son capaces de construir, probar y desplegar software de principio a fin en cuestión de minutos. Esta capacidad está transformando el panorama de la ingeniería de software, pero también está introduciendo nuevas brechas de seguridad que muchas organizaciones no detectan hasta que ocurre un problema.

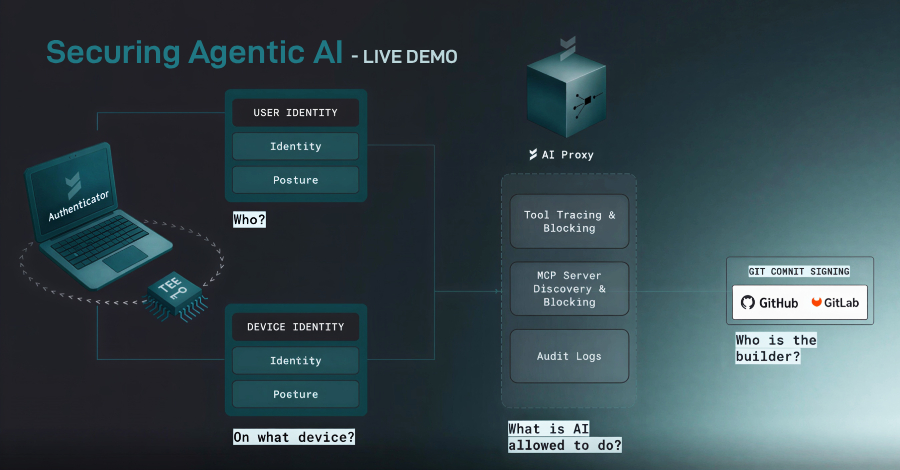

El Papel de los Controladores de Máquina

Detrás de cada flujo de trabajo de un agente, existe una capa de controladores de máquina que pocas organizaciones están asegurando activamente. Los Controladores de Máquina (MCPs, por sus siglas en inglés) son cruciales para el funcionamiento de las herramientas de IA, ya que permiten la ejecución de código y la automatización de tareas. Sin embargo, la falta de atención a la seguridad de estos controladores puede resultar en vulnerabilidades críticas.

Comprendiendo los Controladores de Máquina

Los controladores de máquina son interfaces que permiten a los sistemas de IA interactuar con el hardware y otros sistemas operativos. Proveen el acceso necesario para que las herramientas de IA lleven a cabo tareas complejas sin intervención humana. Sin embargo, si no se gestionan adecuadamente, pueden convertirse en un punto de entrada para ataques maliciosos.

Desafíos de Seguridad en el Agente IA

La velocidad con la que las herramientas de IA pueden implementar soluciones es impresionante, pero también plantea desafíos significativos en términos de seguridad. Algunos de los principales desafíos incluyen:

- Acceso a Herramientas Inseguras: El acceso no controlado a herramientas de IA puede permitir que actores maliciosos ejecuten código malicioso.

- Proliferación de Claves API Fantasma: La gestión de claves API no controladas puede llevar a un desbordamiento de claves fantasma, que son difíciles de rastrear y asegurar.

- Falta de Supervisión: Muchas organizaciones carecen de la supervisión necesaria para detectar y mitigar amenazas en tiempo real.

Soluciones para Mitigar los Riesgos

Para abordar estos desafíos, las organizaciones deben implementar una serie de medidas de seguridad proactivas:

Gestión de Accesos y Permisos

Implementar una gestión estricta de accesos y permisos para garantizar que solo los usuarios autorizados tengan acceso a las herramientas de IA. Esto puede lograrse mediante la adopción de políticas de seguridad como el principio de menor privilegio.

Monitoreo en Tiempo Real

Establecer sistemas de monitoreo en tiempo real que puedan detectar y responder a actividades sospechosas de inmediato. Esto incluye el uso de soluciones de seguridad avanzadas que integren inteligencia artificial para analizar patrones de comportamiento.

Control de Claves API

Mantener un inventario preciso y actualizado de todas las claves API utilizadas por la organización, asegurando que cada clave esté adecuadamente protegida y eliminando las que ya no son necesarias para reducir el riesgo de exposición.

Conclusiones

La integración de un agente de inteligencia artificial en los procesos de desarrollo de software ofrece ventajas significativas en términos de eficiencia y capacidad. Sin embargo, estas ventajas deben equilibrarse con prácticas de seguridad robustas para proteger a las organizaciones de posibles amenazas. Al adoptar medidas de seguridad adecuadas, las organizaciones pueden disfrutar de los beneficios del agente de IA mientras mitigan los riesgos asociados.

Adaptado con Inteligencia Artificial – © Canal Ayuda

Fuente Original: Leer artículo completo